Na svojoj stranici, OpenAI upozorava korisnike da ne dijele osjetljive informacije, dok Google savjetuje korisnicima Geminija da ne unose povjerljive podatke.

Iako mnogi korisnici ChatGPT-a traže pomoć za različite stvari, od savjeta za bračnu terapiju do pisanja profesionalnih e-mailova ili čak pretvaranja slika svojih kućnih ljubimaca u ljudske likove, korištenje umjetne inteligencije nosi i određene rizike po privatnost.

Kako prenosi New York Post, prema riječima Jennifer King, stručnjakinje sa Stanford instituta za umjetnu inteligenciju usmjerenog na ljudsko iskustvo, sve što unesete u chatbot može postati javno jer “gubite vlasništvo nad tim podacima“.

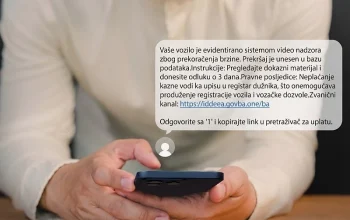

Upravo zato važno je pridržavati se nekoliko osnovnih pravila kada komunicirate s AI chatbotom. Na svojoj stranici, OpenAI upozorava korisnike da ne dijele osjetljive informacije, dok Google savjetuje korisnicima Geminija da ne unose povjerljive podatke. Ako koristite umjetnu inteligenciju, evo pet stvari koje nikada ne biste trebali dijeliti s ChatGPT-om ili sličnim chatbotovima.

Lični, vozački i zdravstveni podaci

Nikada nemojte dijeliti informacije koje mogu otkriti vaš identitet, poput broja lične karte, podataka s vozačke dozvole, pasoša, datuma rođenja, adrese ili broja telefona. Iako neki chatboti pokušavaju prepoznati i ukloniti osjetljive informacije, najbolje ih je potpuno izbjegavati.

– Naš cilj je da naši AI modeli uče o svijetu, a ne o pojedincima – izjavila je glasnogovornica OpenAI-ja, prenosi Večernji list.

Zdravstveni podaci

Zdravstveni podaci su zaštićeni zakonima o privatnosti, ali AI chatboti uglavnom nemaju tu zaštitu. Ako trebate pitati ChatGPT da protumači medicinske nalaze, King savjetuje da prethodno izrežete ili uredite dokument, ostavljajući samo rezultate testova, bez ličnih podataka.

Finansijski podaci

Nikada ne dijelite brojeve svojih bankovnih računa, investicija ili druge finansijske informacije, jer bi ih hakeri mogli zloupotrijebiti i iskoristiti za pristup vašem novcu.

Lozinke

Iako bi se moglo činiti praktičnim dijeliti korisnička imena i lozinke s chatbotom zbog određenih zadataka, oni ne mogu garantovati sigurnost vaših računa. Najbolje je koristiti menadžer lozinki za čuvanje tih podataka.

Podaci o klijentima

Ako koristite ChatGPT ili slične chatbotove u poslovne svrhe — recimo, za pisanje e-mailova ili uređivanje dokumenata — postoji rizik da nehotice otkrijete podatke o klijentima ili poslovne tajne. Neke kompanije koriste vlastite, zatvorene verzije AI sistema ili imaju dodatne sigurnosne mjere za zaštitu podataka.

Kako koristiti AI uz zaštitu privatnosti

Ako želite nastaviti koristiti chatbotove bez ugrožavanja privatnosti, stručnjaci preporučuju korištenje jakih lozinki, višefaktorske autentifikacije i redovno brisanje historije razgovora.

Neke kompanije, poput Anthropic-a, navode da se podaci izbrisani s platforme trajno brišu nakon 30 dana. Iako AI može olakšati mnoge zadatke, uvijek se pridržavajte osnovnih pravila zaštite privatnosti kako biste izbjegli moguće prijetnje.